在当今大数据时代,海量数据处理已成为企业和科技领域的核心挑战。从单体应用的并发编程到大规模分布式系统的构建,程序与系统开发的演进体现了技术对数据增长的适应与创新。本文将探讨这一发展脉络,并分析关键技术和未来趋势。

一、并发编程:应对数据增长的基础

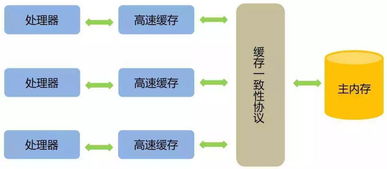

随着数据量的爆炸式增长,传统单线程程序已无法有效处理海量数据。并发编程通过多线程、异步处理等技术,提升程序执行效率。例如,Java的并发包、Go语言的goroutine机制,使开发者能够编写高性能的并发应用。并发编程也带来了竞态条件、死锁等复杂问题,需要通过锁机制、原子操作和事务管理来保障数据一致性。

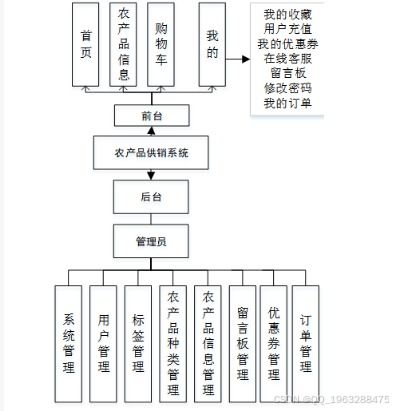

二、分布式系统:扩展性与可靠性的关键

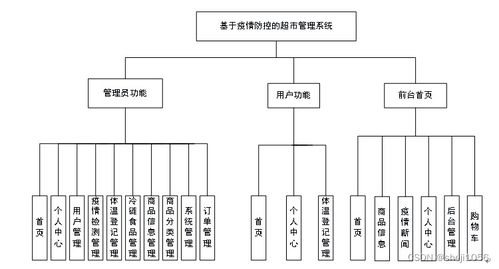

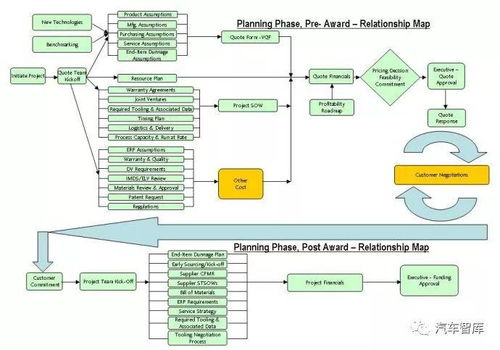

当数据规模超越单机处理能力时,分布式系统应运而生。它将任务分解到多台机器上,通过协同工作实现水平扩展。核心技术包括分布式存储(如HDFS、Cassandra)、分布式计算(如MapReduce、Spark)和消息队列(如Kafka)。这些系统不仅提升了吞吐量,还通过冗余和容错机制保证了高可用性。例如,微服务架构将应用拆分为独立服务,每个服务可独立部署和扩展,进一步优化了资源利用。

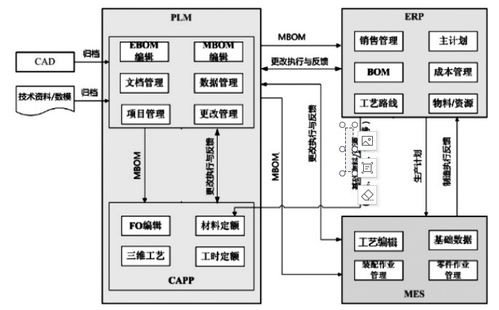

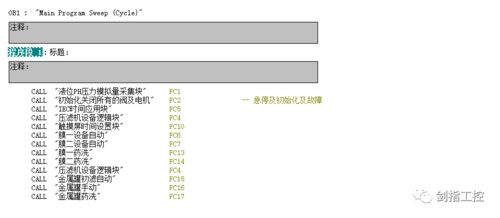

三、程序与系统开发的集成实践

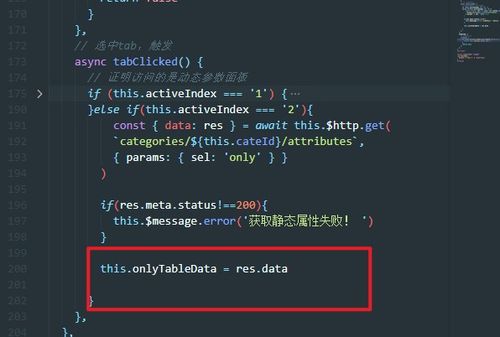

在实际开发中,程序与系统需紧密结合。开发者需掌握并发编程模型(如Actor模型、反应式编程)以优化单机性能,同时理解分布式系统原理(如一致性协议、负载均衡)来设计可扩展架构。工具链如Docker和Kubernetes简化了部署与管理,而监控系统(如Prometheus)则提供了实时洞察。数据安全与隐私保护也日益重要,需在系统中融入加密和访问控制机制。

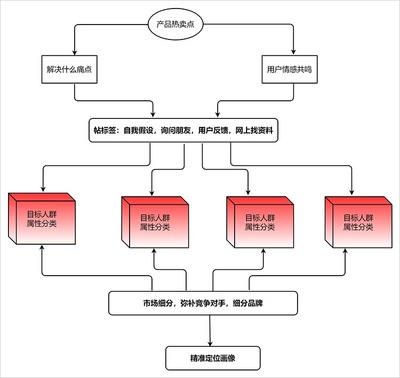

四、挑战与未来展望

海量数据处理仍面临延迟、一致性和成本等挑战。边缘计算的兴起将数据处理推向网络边缘,减少延迟;而AI与机器学习的集成,则使系统能自适应优化。量子计算和异构计算可能带来革命性突破,但核心仍在于平衡性能、可靠性与开发效率。

从并发编程到分布式系统,程序与系统开发不断演进,为海量数据处理提供了强大支撑。开发者需持续学习,拥抱新技术,以构建高效、可靠的下一代数据平台。